La robotica consente una gestione più precisa e sostenibile delle risorse in agricoltura ma la sua implementazione nei campi non è così semplice per via delle condizioni operative mutevoli. Le possibili applicazioni dei robot nel settore agricolo sono al centro della ricerca del Disaa (Dipartimento di scienze agrarie e ambientali) dell'Università degli Studi di Milano e dell'AIRLab del Politecnico di Milano.

Serve un approccio multidisciplinare

Abbiamo fatto una full immersion nel mondo accademico per capire come nascono nuovi robot che siano d'ispirazione per il comparto delle macchine agricole e per saperne di più sui progetti Metrics e Mind FoodHub. Entrambi hanno in comune team universitari con diverse competenze ma orientati al lavoro di squadra.

Metrics, puzzle di competenze

"Nell'ambito del progetto Metrics, noi di AIRLab ci siamo concentrati sullo sviluppo del software e dell'intelligenza artificiale del mezzo autonomo in studio. La squadra guidata da Davide Facchinetti, docente al Disaa, si è occupata della parte meccanica individuando il motore, la trasmissione, gli organi di propulsione e gli attrezzi più adatti" specifica Matteo Matteucci, professore di Robotica e intelligenza artificiale presso il Politecnico.

Mind FoodHub, collaborazione su più fronti

"Per realizzare il robot di Mind FoodHub, abbiamo collaborato con il Dipartimento di informatica dell'Università di Milano e con un'azienda attiva nel settore dell'automazione dei veicoli - spiega Aldo Calcante, docente di Meccanica agraria al Disaa che lavora al progetto insieme al professor Roberto Oberti e ai ricercatori Enrico Ferrari, Daniele Manenti e Marco Torrente.

"Noi abbiamo definito le specifiche tecniche e le funzioni del mezzo per renderlo capace di operare in serra, in pieno campo o tra i filari, in piano o in pendenza, spiega il docente. Il Dipartimento di informatica ha realizzato l'interfaccia di connessione che si basa sulla rete TIM e usa un router 5G per gestire e lo scambio di dati tra robot e cloud".

Controllo di grappoli e infestanti? Lo fanno UniMi e PoliMi

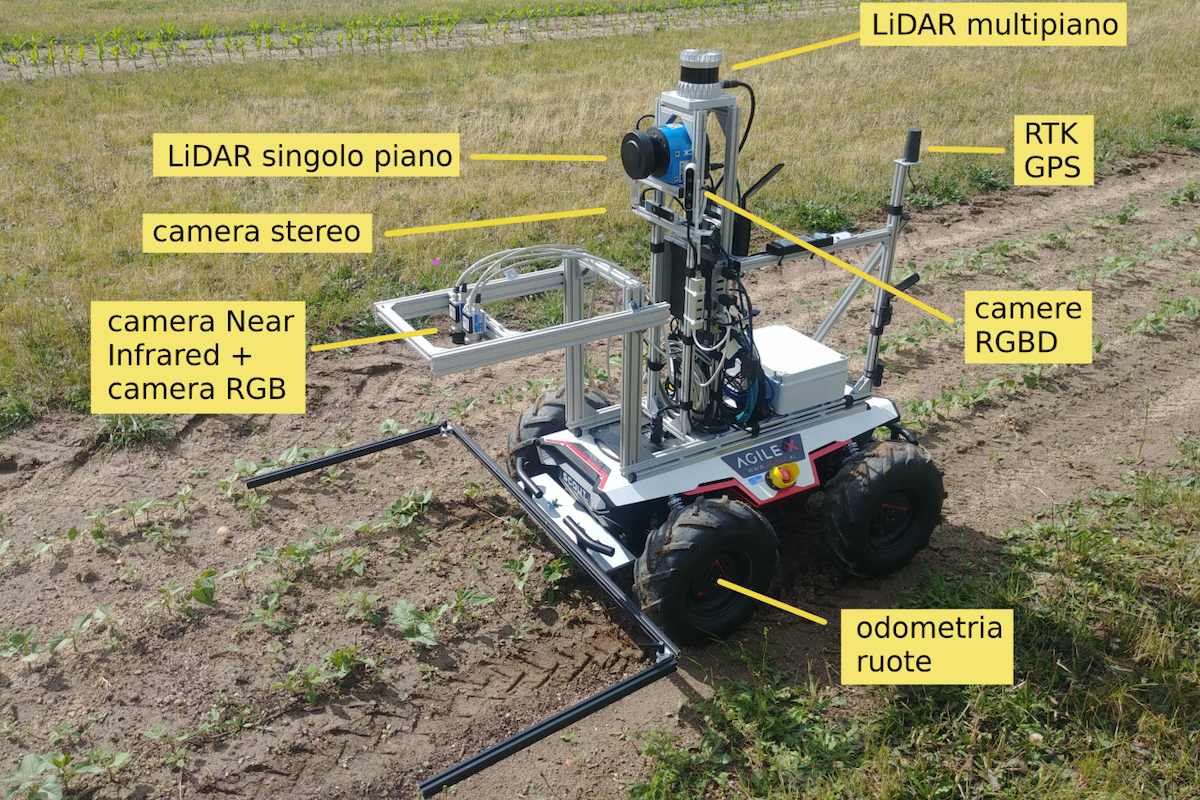

I gruppi di ricerca dei proff. Matteucci e Facchinetti, operativi nell'ambito del progetto Metrics, hanno creato - a partire da un robot sperimentale già usato per il riconoscimento e la mappatura dei grappoli in vigneto - un robot che mappa la presenza delle malerbe in pieno campo. Testato anche nel contesto della competizione Acre, è costituito dalla piattaforma elettrica a 4 ruote motrici Scout 2.0 dell'azienda Agile X Robotics su cui sono montati sensori Lidar multipiano e a singolo piano, telecamere RGB e RGBD, telecamere iperspettrali e un computer con software made in AIRLab.

"Il sensore Lidar multipiano, montato più o meno in alto a seconda del contesto operativo, esplora l'ambiente circostante al robot con 64 raggi laser rotanti, misurando la distanza degli oggetti e comunicando le informazioni al software per il comando delle ruote - sottolinea Matteucci. Grazie ai 2 Lidar (singolo piano e multipiano), il robot ha una percezione tridimensionale dell'ambiente , che sfrutta per definire il proprio movimento: ad esempio per mantenersi con precisione al centro dello spazio interfila". È comunque presente un'antenna Gps che legge segnali di correzione Rtk.

Robot per scouting Metrics ricco di sensori e telecamere

(Fonte foto: AIRLab)

Le telecamere iperspettrali installate in alto per lo scouting in vigneto o puntate davanti e in basso per il rilievo in campo aperto, acquisiscono immagini nello spettro del visibile o del vicino infrarosso Nir e le inviano al software di bordo. Questo, sfrutta reti neurali per analizzare le immagini eseguendo la segmentazione - cioè la distinzione tra grappoli e foglie di vite o tra malerbe e piante coltivate - ed elaborando informazioni utili alla creazione di modelli di accrescimento delle colture.

"Il robot, concepito per funzionare senza trasmettere dati in remoto, ha fornito ottimi risultati in vigneto e in campi di mais e fagiolo - fa sapere Matteucci. Ha analizzato correttamente circa l'80% dei pixel delle immagini, non riuscendo a distinguere solo pochi acini del grappolo o piccole parti delle infestanti".

Work in progress in vista di Acre 2023

La piattaforma robotica usata per Metrics è funzionale allo sviluppo di un altro robot più adatto all'uso in campo che manterrà i software per la navigazione, il riconoscimento delle malerbe e l'analisi della rigogliosità ma avrà una base diversa da Scout 2.0.

"Il software del nuovo mezzo potrà elaborare una risposta immediata comunicando ai bracci robotici di raccogliere il grappolo o rimuovere l'infestante meccanicamente - afferma Davide Facchinetti, professore di meccanica agraria al Disaa. In alternativa, grazie all'esperienza maturata sul prototipo, potremo montare un atomizzatore o una barra irroratrice con manichetta per effettuare trattamenti fitosanitari con quantità di fitofarmaci correlate alla vegetazione infestante effettivamente presente in campo. Il risultato sarebbe una migliore copertura con minori sprechi".

Il robot Metrics è il predecessore di un robot porta attrezzi più adatto all'uso in campo

(Fonte foto: AIRLab)

Salvo ritardi dovuti al reperimento di chip elettronici da parte del costruttore incaricato, il robot attuale si trasformerà in un mezzo modulare, full electric e capace di svolgere varie operazioni a seconda degli attrezzi installati. "Puntiamo a portare il nuovo modello ad Acre 2023, in programma presso l'azienda agraria didattica Cascina Baciocca di Cornaredo il prossimo maggio - anticipa Facchinetti. Durante la competizione, noi e altre realtà italiane, francesi e canadesi testeremo le potenzialità di diversi robot".

Nel frattempo, il gruppo di lavoro prenderà parte a un progetto promosso dall'Unione Europea che prevede la creazione di strutture di testing a supporto delle aziende che sviluppano prodotti per l'agricoltura basati su robotica e intelligenza artificiale. Le nuove strutture consentiranno alle aziende di valutare sperimentalmente le prestazioni dei loro prototipi e prodotti, e dunque di ottimizzarne lo sviluppo. "Nel corso di Acre 2023 organizzeremo attività per presentare alle aziende interessate i servizi offerti dalle strutture di testing in via di realizzazione", aggiunge Matteucci.

Mind FoodHub, un aiuto nel monitoraggio colturale

Il robot del secondo progetto, Mind FoodHub, misura la risposta della lattuga a trattamenti con biostimolanti usati per aumentare la resa e ridurre il ricorso ai fertilizzanti. In fase di test presso la serra della Cascina Baciocca, è costituito da una piattaforma cingolata di origine commerciale che presenta un sensore Lidar nella parte anteriore e un braccio laterale con 2 telecamere collegate a una centralina.

"Il ricevitore satellitare Rtk non è utilizzabile in serra e per questo - precisa Calcante - abbiamo programmato le rotte basandoci solo sul segnale proveniente dal laser scanner del sensore Lidar adottando un nuovo approccio alla navigazione. Abbiamo utilizzato il calcolo delle distanze lineari rispetto ad alcuni punti di riferimento che non sempre ha permesso di ottenere precisioni centimetriche".

Robot Mind FoodHub per la misura della risposta della lattuga ai biostimolanti

(Fonte foto: AgroNotizie)

All'avvio del mezzo, il sensore Lidar costruisce una mappa degli ostacoli e degli oggetti usati per definire i confini della serra. Utilizzando la mappa il robot si orienta accorgendosi di eventuali differenze rispetto alla condizione di partenza e costruendo un percorso alternativo. Inoltre, previo inserimento di punti di riferimento prossimi alle parcelle, sa dove fermarsi per acquisire dati. Gli spostamenti possono essere automatici o controllati a distanza dall'operatore tramite telecomando.

"Una telecamera 3D e una a colori acquisiscono immagini utilizzabili per ricostruire il volume delle piante - spiega Daniele Manenti. Poi la centralina invia le foto in cloud, tramite router 5G, a un database remoto gestito dal Dipartimento di Informatica". Un telo apribile ombreggia la parcella migliorando la qualità delle immagini in caso di forte luminosità.

Un accelerometro consente di valutare l'inclinazione del braccio: se la distanza del braccio da terra varia, si esegue la compensazione delle immagini raccolte. Per l'alimentazione dei motori elettrici sui cingoli e dei sistemi di controllo, ci sono batterie agli ioni di litio ricaricabili in poche ore.

Dallo scouting all'intervento in campo

Il robot, finora usato per valutare l'effetto dei biostimolanti solo su lattuga in serra, sarà presto testato presso la Cascina Baciocca, anche su altre orticole e in pieno campo. Per lavorare in campo aperto sicuramente sarà necessario installare un sistema Gps.

Guarda la fotogallery dei robot sviluppati dall'Università di Milano e dall'AIRLab del Politecnico di Milano

"Introdurremo a breve una camera iperspettrale per confrontare le immagini in bande spettrali diverse potendo svolgere misure nutraceutiche sulle piante coltivate e rilievi tempestivi di malattie - sostiene Calcante. Integreremo anche attuatori per la distribuzione precisa di agrofarmaci sulle piante dove serve e, in generale, il controllo operativo automatico. Per fare ciò metteremo a punto procedure basate sull'intelligenza artificiale".

Il gruppo di lavoro affiancherà allo sviluppo del robot per il monitoraggio colturale e i trattamenti fitosanitari localizzati, un'intensa attività di divulgazione dei risultati. "Attraverso pubblicazioni di articoli su riviste o nella sezione Disaa press e diverse giornate dimostrative, anche aperte al pubblico, informeremo gli operatori del settore e i cittadini sui progressi del progetto Mind FoodHub" conclude Calcante.